6G显存玩转130亿参数大模型,仅需13行命令,RTX2060用户发来贺电

作者:啊哈哈哈 来源:ai08门户网 时间:2025-05-18 11:37:02

Meta的大语言模型LLaMA 13B,现在用2060就能跑了~

羊驼家族的Alpaca和Vicuna也都能运行,显存最低只需要6G,简直是低VRAM用户的福音有木有。

GitHub上的搭建教程火了之后,网友们纷纷跑来问苹果M2是不是也能跑。

这通操作的大致原理是利用最新版CUDA,可以将Transformer中任意数量的层放在GPU上运行。

与此前llama.cpp项目完全运行在CPU相比,用GPU替代一半的CPU可以将效率提高将近2倍。

而如果纯用GPU,这一数字将变成6倍。

网友实测的结果中,使用CPU每秒能跑2.1个token,而用GPU能跑3.2个。

生成的内容上,开发者成功用它跑出了“尼采文学”。

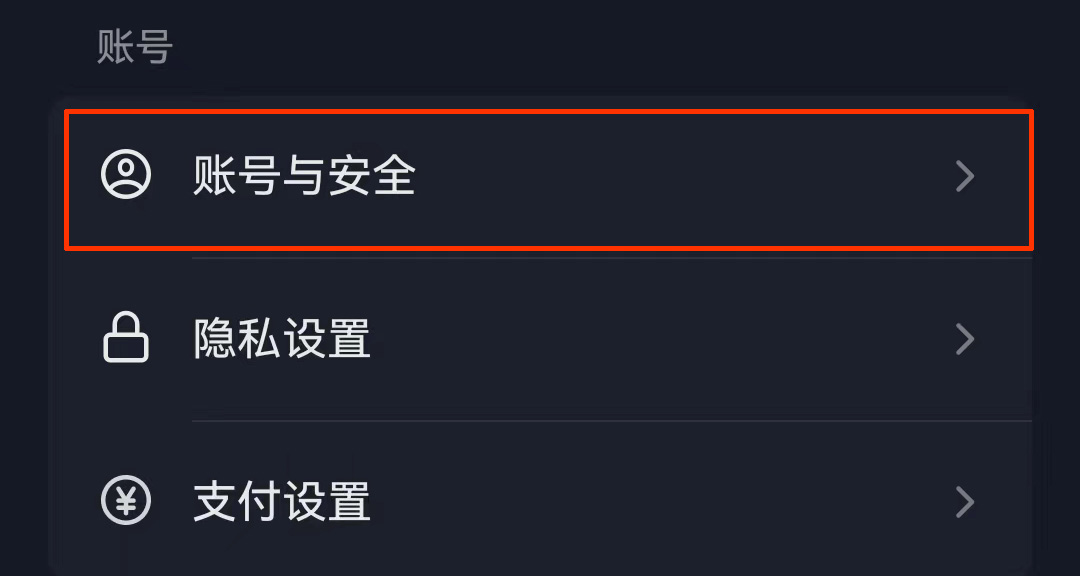

在开始搭建之前,我们需要先申请获得LLaMA的访问权限。

传送门:https://ai.facebook.com/blog/large-language-model-llama-meta-ai/

此外还需要有一个Linux环境。(Windows用户可以用WSL2)

准备工作完成之后,第一步是将llama.cpp克隆到本地。

更多资讯

热门文章

推荐对话

换一换- 人气排行

- 1 6G显存玩转130亿参数大模型,仅需13行命令,RTX2060用户发来贺电

- 2 密码写死、身份验证未加密,Pepper机器人拉低了程序员界的智商

- 3 平均每个员工2000万!苹果为啥买下这家刚成立3年的AI创业公司?

- 4 苹果最新专利曝光:iPhone也能玩屏幕指纹解锁

- 5 中国AI专利申请量超越美国:百度排名第一,国外企业申请量占20%

- 6 量子位智库报告:XR火爆,Why now? | 附下载

- 7 贺建奎论文手稿意外曝光!基因编辑实验竟充满谎言:HIV抗性未被验证,且造成意外突变

- 8 Copilot免费时代结束!正式版67元/月,学生党和热门开源项目维护者可白嫖

- 9 挑食、乱伦、用AI认树……这是今年Nature钦点的十大研究

- 10 NLP最实用教程可以白嫖了!理论知识+项目实践,还配V100免费算力